DeepSeek V3 模型已完成小版本升级,目前版本号 DeepSeek-V3-0324,用户登录官方网页、APP、小程序进入对话界面后,关闭深度思考即可体验。API 接口和使用方式保持不变。

如非复杂推理任务,建议使用新版本 V3 模型,即刻享受速度更加流畅、效果全面提升的对话体验。

模型选择

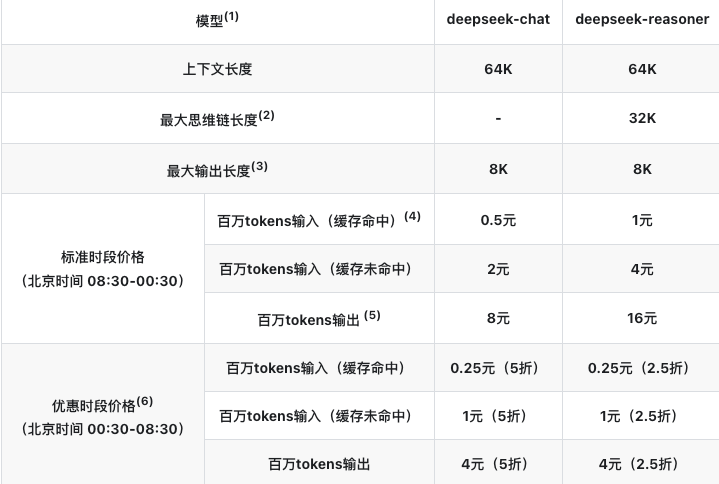

https://api-docs.deepseek.com/zh-cn/quick_start/pricing

对话和推理模型:

deepseek-chat 模型对应 DeepSeek-V3

deepseek-reasoner 模型对应 DeepSeek-R1

编程模型:deepseek-coder

temperature配置

temperature 参数默认为 1.0。

LLM中的一个耐人寻味的参数是 「温度」。「温度」是一个用于调整模型生成文本时创造性和多样性的超参数。「温度」是一个大于0的数值,通常在 0 到 1 之间。它影响模型生成文本时采样预测词汇的概率分布。当模型的「温度」较高时(如 0.8、1 或更高),模型会更倾向于从较多样且不同的词汇中选择,这使得生成的文本风险性更高、创意性更强,但也可能产生更多的错误和不连贯之处。而当「温度」较低时(如 0.2、0.3 等),模型主要会从具有较高概率的词汇中选择,从而产生更平稳、更连贯的文本。但此时,生成的文本可能会显得过于保守和重复。

“温度参数通常通过添加一个标量乘以 softmax 函数的输出来实现,对这个概率分布进行调整”,softmax 输出的概率分布会被人为地扭曲,从而生成可能性较小的标记

https://zhuanlan.zhihu.com/p/666670367

token价格

评论区