我的AI模型使用情况分享

首先,大多数国内云厂商和模型服务商的模型我都接入和使用过,以下是根据实际体验得出的算力服务上自测评价,排序靠前说明体验感和实际使用效果很好;

我的模型体感(云厂商和模型商)

主要以稳定性、模型质量、使用体验为主的主观描述,国外模型不在表单里,因为属于算力能力和模型能力双领先;

| 排名 | 平台 | 我的推荐理由 | 我的使用劣势感受 |

|---|---|---|---|

| 1 | 火山引擎 / 火山方舟 | 我会把它作为线上生产环境的首选,尤其适合需要低延迟、高稳定性和持续调用的业务。 | 我觉得它的优势主要集中在生产稳定性上,如果追求极限低价,可能不是最便宜的选择。 |

| 2 | 阿里云百炼 | 我会把它作为企业级 AI 应用和多模型生态的主力平台,尤其适合需要工具链、Batch、长上下文和模型管理的场景。 | 我觉得它的产品体系比较完整,但也相对复杂,上手和配置成本会比单一 API 平台高一些。 |

| 3 | DeepSeek 官方 | 我会把它作为低成本、高性价比调用 DeepSeek 模型的首选,适合大批量、成本敏感的任务。 | 我在高峰期可能会担心它的稳定性和响应速度,所以不一定会把它单独作为核心生产依赖。 |

| 4 | 腾讯云 | 我会把它作为腾讯云生态内项目的补充选择,尤其适合已经在腾讯云上部署业务的场景。 | 我觉得它在价格和综合体验上不算最突出,如果没有腾讯云生态绑定,吸引力会弱一些。 |

| 5 | 硅基流动 | 我会把它作为模型试验和多模型切换的平台,适合快速测试不同开源模型和低成本方案。 | 我觉得它更适合测试和非实时任务,强实时生产场景下我会更谨慎。 |

| 6 | MiniMax 官方 | 我会在长上下文、多模态、语音或特定 MiniMax 模型能力上优先考虑它。 | 我不会把它作为通用推理 API 的第一主力,因为平台综合稳定性和生态证据不如火山、阿里这类云厂商充分。 |

| 7 | 智谱 GLM 官方 | 我会在中文场景、长上下文、工具调用和国产模型适配上考虑 GLM。 | 我觉得它的模型能力有特色,但公开的第三方平台级压测资料相对不足,所以生产主力选择上我会保守一些。 |

| 8 | 天翼云息壤 | 我会在政企、国产化、合规、央国企或电信体系项目里优先考虑它。 | 我觉得它更偏政企交付和合规场景,作为个人开发者或互联网产品的主力 API,体验和灵活度可能不是最优,当前缺失缓存机制,成本很高且模型上下文窗口阉割和算力不足。 |

我的主力模型

gpt + glm5.1

- 企业使用: 火山放在线上实时调用、Agent 后端、需要稳定低延迟的任务;阿里放企业生态、Qwen、百炼工作流、Batch、长上下文和多模型兜底

- 个人使用: Claude/Codex 更像"会干活的工程师" 或智谱的coding plans

- 政企客户: 尤其是电信、政务、金融、央国企场景,息壤价值在合规、国产算力、专网和交付,但个人开发者不推荐

国内模型

模型自测排行

- GLM5.1(推荐,中等难度编程 或 自主任务执行)

- DeepSeek v4(可以赶上GLM5.1)

- MiniMax 2.7(在复杂任务执行,效果欠佳,比如openclaw的agent自主任务)

- Seedance 2.0(推荐,视频质量还可以,够用)

- MiniMax 2.5 和 GLM5(仅适合简单任务)

- 豆包 = 千问 > 元宝(网页使用推荐前2个)

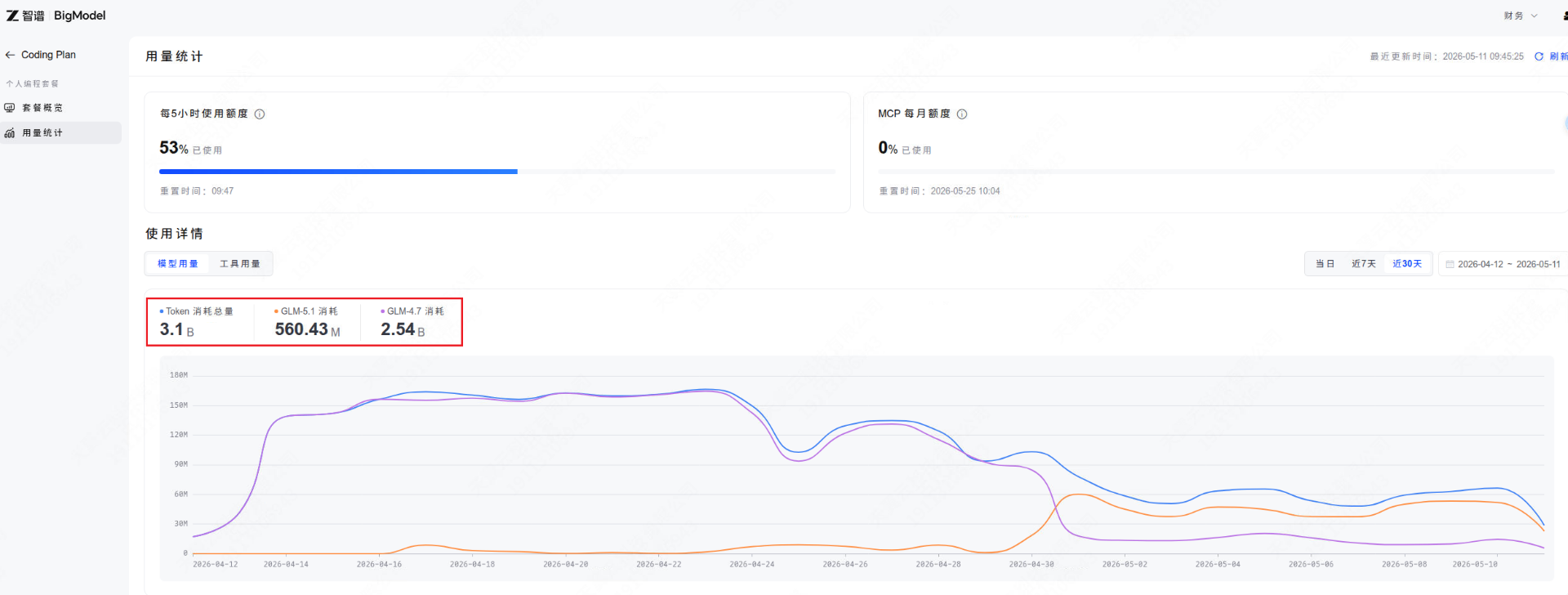

模型用量数据

- 我的智谱AI,开通的是季度lite套餐,月度使用量截止到现在是31亿tokens;

- 我的MiniMax开通的是Pro版本,主要是给openclaw在中等使用场景,自主调用,比如新闻或资讯类消息检索、整理、分析和回报;

通过AI agent自主,我使用vibe coding 在98%的AI自主工作下,完整信息搜索、分析、整理和线上网站展示:https://024news.us/daily-report 和 https://fake.024news.us/

对DeepSeek,我使用的是天翼云息壤的产品算力,原因是:免费,O(∩_∩)O哈哈~

对云厂商的coding plans,我这里不是很推荐,原因是体验下来,算力速度和限制比模型厂商更慢和限制多,且后续也不一定能稳定使用最新模型,在当前阶段,推荐以模型上的coding plans为主,再结合自身公司的免费套餐为辅;

USA模型

模型自测排行

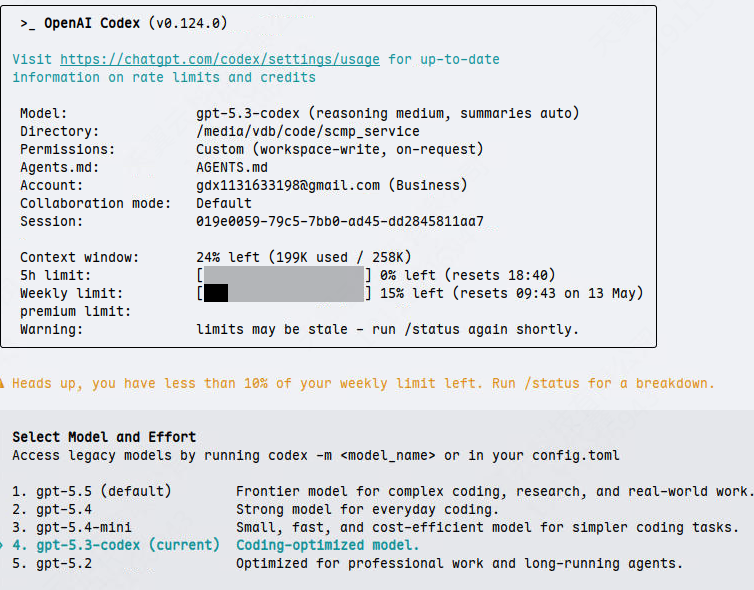

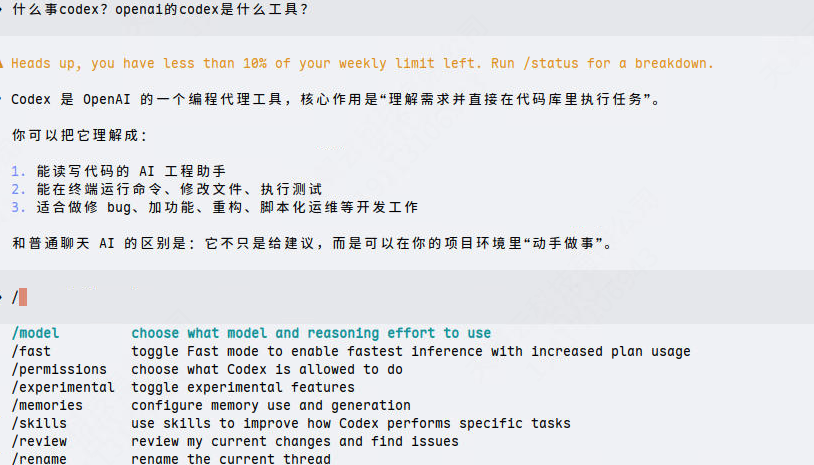

- OpenAI ChatGPT(推荐,以codex为核心的办公套件,能够胜任复杂任务的执行)

- Claude(推荐复杂工作使用,但是对中国用户屏蔽严重)

模型用量数据

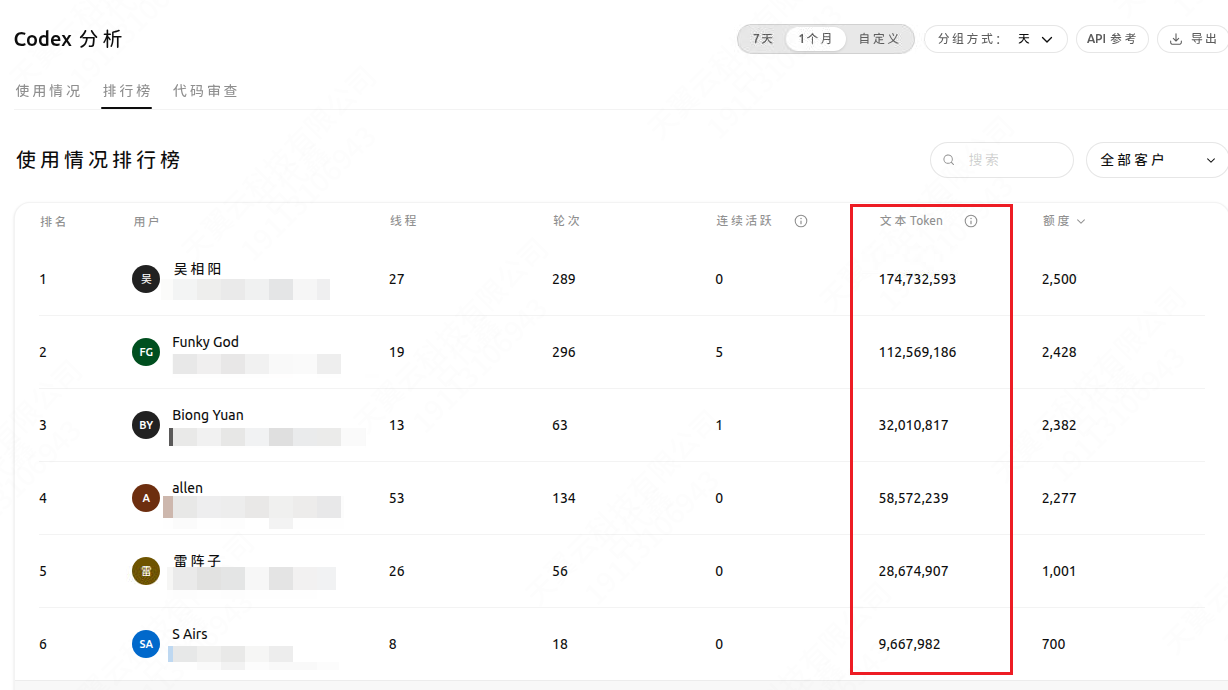

Codex团队版现在我们是6人使用,按照周和5小时限制最大使用量,基本上在工作时间,5小时使用额度是被榨干的,因为GPT系列对复杂工作能够自主完成的很好(编程+办公),缓存命中大幅度节省了tokens使用量;

我的AI工作(非模型层面)

| 排名 | 工具 | 我会怎么用 | 我最担心什么 |

|---|---|---|---|

| 1 | Codex | 我会把它作为关键代码任务、PR Review、修 bug、重构的主力。 | 成本、额度、生态绑定,以及仍然需要人工复核。 |

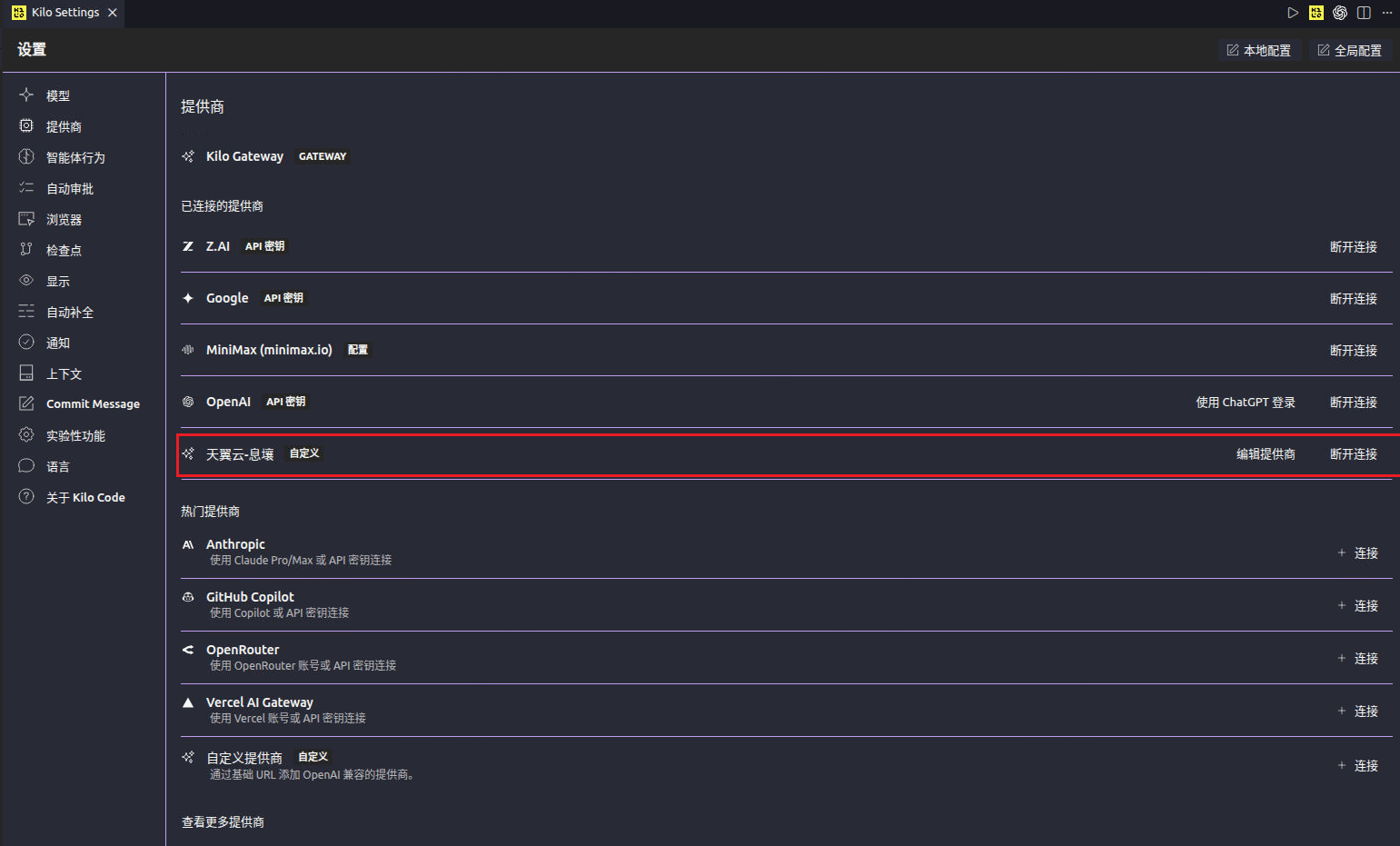

| 2 | Kilo Code | 我会把它作为多模型、多 IDE、团队化 AI 编程工作台。 | 功能复杂,团队落地需要规范和权限控制。 |

| 3 | opencode | 我会把它作为开源、可控、可换模型的本地/终端 Agent。 | 配置和维护成本较高,团队管理能力不如商业平台。 |

| 4 | OpenClaw + 飞书 | 我会把它作为飞书办公自动化、知识库、日程、文档和任务助手。 | 权限太强,安全边界必须严格控制。 |

Codex

我会把 Codex 当成工程级 AI 编程 Agent,适合做代码审查、修 bug、生成 PR、处理后端任务和多文件修改。OpenAI 官方也把它定位为 coding agent,并强调 CLI、桌面端、PR review 等工作流;在个人开源开发工作中:把它放在核心代码任务、复杂重构、review、修线上 bug、生成测试这些高价值任务上。

opencode

在公司工作中:我会把 opencode 当成开源版 Claude Code / Codex 类工具,适合想自己掌控模型、终端体验和上下文的开发者。它官方 GitHub 明确写着是 "open source coding agent"。配合息壤的算力模型,使用GLM5.1进行开发和日常工作。

- 我会觉得它更适合懂技术、愿意折腾的人;如果团队要开箱即用、统一管理,体验可能不如商业工具。

- 开源不等于低维护成本。我需要自己处理配置、权限、模型 key、安全策略和团队规范

Kilo Code

是Vscode里的插件和电脑里的cli工作:我会把 Kilo Code 看成更产品化的开源/多模型 AI 编程平台,不只是一个 CLI。它公开页面强调 VS Code、JetBrains、CLI、Slack、云代理、代码审查、部署、并行 Agent 等能力。综合体验比opencode更好,通过UI更好更容易上手使用。

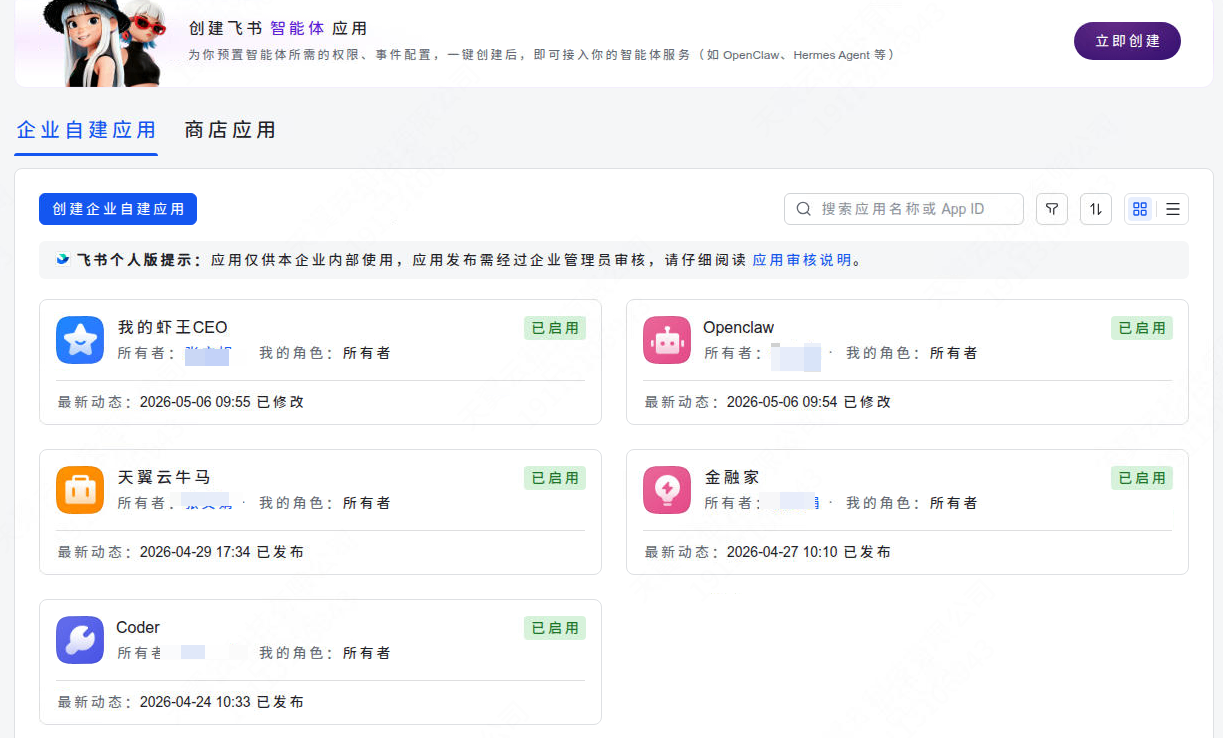

OpenClaw + 飞书

我会把 OpenClaw + 飞书看成办公自动化 Agent,不是纯代码工具。OpenClaw 官方 GitHub 把它描述为运行在自己设备上的个人 AI 助手,可以通过已有渠道响应用户。我不会把它和 Codex、opencode、Kilo Code 直接同类比较;它更像"飞书里的数字助理/办公 Agent"。

注意:OpenClaw + 飞书适合做"办公/协作/知识库 Agent",但我会把安全和权限放在第一位。它不是最强代码 Agent,而是最适合飞书生态的行动型助手。